потоки данных

7 ноября 2016 года, за день до президентских выборов в США, The New Inquiry записал разговор по Skype между художницей и писательницей Хито Штейерль и исследовательницей и писательницей Кейт Кроуфорд. Они обсудили ребят из АНБ (Агентство национальной безопасности США), слежку с помощью данных, сверххищников и машины по производству эмпатии.

Кейт Кроуфорд: Хито, мы познакомились, когда обе работали над архивом Эдварда Сноудена. Поговорим немного о том, какой опыт получила каждая из нас?

Хито Штейерль: Мой опыт работы с тем архивом был очень ограниченным. Я искала один очень простой пример и в итоге написала об одном из изображений, опубликованных на The Intercept. Это кадр из закодированного видео — я попыталась связать его с метафорами, которые аналитики используют для описания своей работы в радиоэлектронной разведке.

Я использовала такие метафоры, как, например, описанное ими «море данных» (sea of data) (которую ты, Кейт, также упоминала в своем эссе для Уитни), чтобы попробовать поразмышлять об ощущении, которое испытываешь, когда как будто тонешь в окружающих тебя данных.

Кейт Кроуфорд: Возвращаясь к той дискуссии в Уитни и размышляя о твоей работе «Море данных», я поняла, что мне понравилось то, что мы обе обнаружили ограничения для познания, заключенные в этих образах. Для тебя этим ограничением стал зернистый кадр из видео. Я, когда писала для The New Inquiry в 2014 году, зациклилась на этом «отцензурированном» образе, который как будто просто говорил «Что мы можем сказать?», и, по сути дела, являлся пустым пространством. У него есть двойное значение, которое мы обе посчитали очень интригующим: это идея, что они могут говорить и видеть все, но также, что есть области, о которых о не могут ничего сказать и где не могут ничего увидеть. У эпистемологической программы «Собери всё» есть жесткие границы, достигая которых, мы получаем нарушение смысла, чрезмерное изобилие и дробление информации до такой степени, что она становится невоспринимаемой, плавающий в огромном океане потенциальных интерпретаций и прогнозов. Когда количество взаимосвязей становится бесконечным, им сложно оставаться связанными с реальностью в любом смысле этого слова. И интересно, что для нас обеих эта ситуация представляет собой контр-нарратив по отношению к современному дискурсу всевидящего и всезнающего государственного аппарата. Этот аппарат на самом деле борется с им же самим собранным чрезмерным изобилием данных и прогнозов. Мы понимаем, что существуют черные дыры, что-то вроде областей иррациональности и информационного коллапса.

Хито Штейерль: Слепой шпион.

Кейт Кроуфорд: Да, точно. И это тоже забавно, потому что, помимо чувства утопления в море данных, в конструировании такого моря содержится какой-то элемент юмора. По крайней мере, для меня в работе над архивом Сноудена все это представлялось огромным лабиринтом, к которому нужно подступиться и…

Хито Штейерль: Но каково это было?

Кейт Кроуфорд: За те несколько месяцев, что я работала над архивом, мне приснились одни из самых ужасных кошмаров в моей жизни. Да и физически это было изматывающе. Но вот эти вкрапления юмора помогли мне через все это пройти. Это черный юмор, и в архиве его много. Некоторые из слайдов написаны в таком гипер-маскулинном, гипер-соревновательном тоне, источник которого я стала персонализировать в виде «чувака из радиоэлектронной разведки». Есть такой голос «чувака из радиоэлектронной разведки», который звучит примерно так: «Да, мы их уделали! Мы можем следить за всеми! Мы поимеем все сети!» Но в этом есть подтекст неуверенности в себе, такая форма поиска одобрения: «Мы хорошо поработали? Мы все правильно сделали?». И эта воображаемая личность «чувака» странным образом помогала мне продолжать работу, потому что она казалось такой человечной и боящейся совершить ошибку.

Хито Штейерль: Я думаю, ты прекрасно показала это в своей презентации: ты использовала мультяшные образы, напоминающие эмодзи, например, образы, связанные с Weatherby (Компания по производству оружия, — прим. пер.), и магию, которая изобилует в первоначальном бессознательном этого архива. Это довольно смешно.

Кейт Кроуфорд: Я думаю, в этом архиве есть очень много бессознательного, вскрытие которого займет значительное время. Я бы хотела поговорить с тобой еще об одной вещи — и тут мы переключаемся с использования данных государством на такую же деятельность корпораций, потому что я знаю, что нам обеим интересно то, как эти две сферы пересекаются, — о проекте IBM по измерению уровня терроризма, о котором я рассказывала в разное время. Я знаю, что нам обеим интересно, как такой вид прогнозов оказывается частным примером куда более широкой склонности квантитативно исследовать человечество в качестве супер-паттерна.

Хито Штейерль: Меня действительно поражает возможность квантификации социальных отношений и убеждение, что каждое социальное отношение граждан и просто людей можно представить в виде некоего числа; это и измерение рейтингов угрозы, и кредитных рейтингов, и рейтингов художников, — последнему измерению я подвергаюсь постоянно. Был, например, замечательный текст о рейтингах участия пользователей джихадистских форумов, но самый интересный пример, который я недавно обнаружила, — это китайский общественный рейтинг честности. Я уверена, что ты о нем слышала, ведь так? Это что-то вроде гражданского «супер-рейтинга», в котором учитываются кредитная история и финансовые транзакции, и не только их количество или оборот, но и их качество, то есть каждую твою покупку рассматривают отдельно. По словам разработчика рейтинга, тому, кто покупает детские подгузники, будет начислено больше баллов, чем кому-то, кто тратит деньги на видеоигры, потому что первый из них считается более «социально ответственным». К тому же, в рейтинге учитывается состояние здоровья, история нарушений ПДД, а также действия в интернете. По сути, составители рейтинга берут довольно весомую картину ваших социальных взаимосвязей и переводят их в одно конкретное число. Это число — уровень вашей «общественной честности». Пока эту систему полностью еще не ввели. Есть кое-какие предшественники, вроде расширенных кредитных историй, которые уже используют. Но ее собираются запустить в 2020 году, что не так уж и нескоро. Меня это просто поражает.

Кейт Кроуфорд: Что меня интересует в вопросе о китайском кредитном рейтинге, так это то, что здесь, на Западе, его обличают как нечто экстремистское, вроде: «Кто вообще мог создать что-то, настолько подверженное ошибкам? и настолько очевидно фашистское по своей сути?» Пусть такое и говорят, но всего лишь неделю назад мы видели, как британская страховая компания The Admiral Group пыталась внедрить на рынок приложение, которое или предлагало бы клиентам скидку на страхование автомобиля, или повышало бы страховую выплату, в зависимости от того, что они пишут на Facebook. К счастью, это приложение заблокировали, но похожие подходы уже внедряются. Приложение Admiral исследовало такие корреляции, как использование человеком восклицательных знаков или слов вроде «всегда» и «никогда», — по их мнению, это значит, что ты опрометчивый и неосторожный и будешь плохим водителем. Так что если ты тот, кто использует эмодзи и восклицательные знаки, ты будешь больше платить за страховку своего автомобиля. Это кажется очень похожим на измерение рейтинга граждан, которое, как мне кажется, проникло в жизнь в США на молекулярном уровне. Американцам легко показывать пальцем на Китай и говорить: «О, у нас бы такого никогда не случилось». Но эти вещи, гораздо менее заметным образом, уже начали становиться частью того, как прогнозируют, страхуют и измеряют наши жизни. Во многом, как мне кажется, это уже даже банальность: китайский рейтинг — это просто то, что уже произошло. Он уже здесь, вне зависимости от того, гражданами какой страны мы являемся.

если ты тот, кто использует эмодзи и восклицательные знаки, ты будешь больше платить за страховку своего автомобиля

По поводу рейтинга терроризма от IBM, есть два аспекта, которые не дают мне покоя. Один из них — это то, что его испытывают и внедряют среди очень уязвимых слоев населения, которые совершенно не подозревают, что эту технологию используют против них. Во-вторых, он основан на очень слабых корреляциях из источников вроде Twitter — на информации о том, что кто-то лайкнул какого-то диджея, и выводах, что этот человек может угрожать безопасности в клубе, в котором этот диджей выступает. Я думаю, что это слишком общие предположения о том, чем занимается тот или иной человеческий субъект и что раскрывают следы его данных. Если использовать концепт «следо-тела» Джесбир Пьюэр, то предположения, которые делаются относительно «следо-тела» становятся настолько натянутыми и в некоторых случаях настолько нелепыми, что критически важно, чтобы мы подвергали сомнению подобное знание на каждом уровне его существования.

Хито Штейерль: Это напоминает мне конец XIX века, когда предпринималось много научных усилий по обнаружению истерии или так называемых «женских душевных болезней». Было выделено очень много критериев выявления этого загадочного заболевания. Я думаю, мы как бы вернулись в эру грубого психологизма, пытаясь связать социальные, ментальные или социально-ментальные отклонения или недостатки с откровенно абсурдными и ненаучными маркерами. Но это просто небольшой комментарий. Продолжай, пожалуйста.

Кейт Кроуфорд: Вообще, я как раз хотела обратиться к истории, так что твой комментарий абсолютно к месту. Я тоже подумала о физиогномии, потому что сейчас появилась новая система под названием Faception, которую обучают на миллионах образов. Говорят, что она может измерить интеллект человека и вероятность того, что он станет преступником, основываясь на форме лица. Похожим образом, недавно было выпущено глубоко подозрительное исследование, которое утверждает возможность автоматического измерения склонности к нарушению закона на основании фотографий человеческих лиц. Так что, по-моему, мы прошли круг. Френологию и физиогномию реанимируют, но уже в рамках распознавания лиц и машинного обучения.

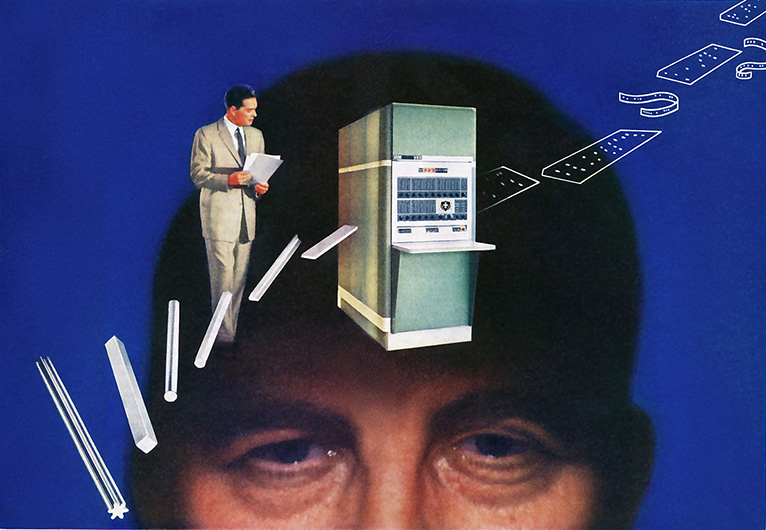

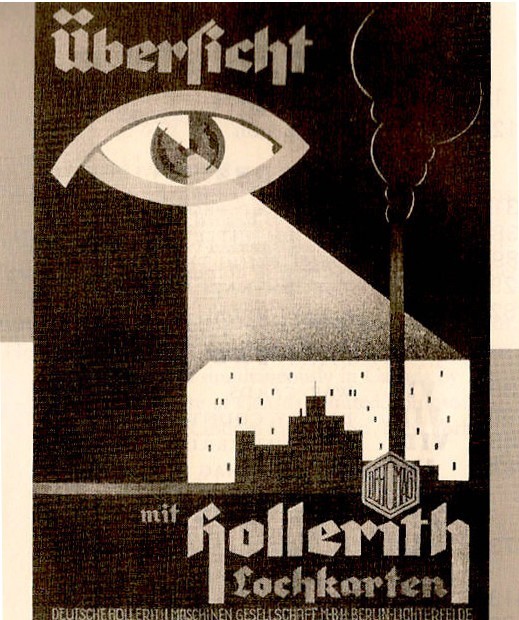

По поводу IBM есть еще действительно интересная история из 1933 года, задолго до появления рейтинга терроризма, когда немецкое подразделение этой компании разрабатывало машину Холлерита. Я исследовала необычный архив рекламных изображений, использованных в то время IBM, и нашла в нем картинку, которая заставила меня подумать о твоей работе: в ней огромный глаз парит в пространстве и испускает лучи света на город под ним, окна в городе выглядят как отверстия в перфокартах, и луч светит прямо внутрь домов. Все это сопровождает слоган: «Увидь все разом с перфокартами Холлерит». Это самый буквальный пример способности «видеть, как государство», который только можно вообразить. Это история IBM, и компания делает круг внутри этой истории. Я совершенно согласна, что мы наблюдаем возвращение истории к формам знания, которые раньше виделись нам по меньшей мере ненаучными, а в худшем случае — откровенно опасными.

Хито Штейерль: Я думаю, что источником этого сдвига парадигмы может быть методология. Насколько я понимаю, статистика на сегодня перешла от построения моделей и попыток испытать их с помощью эмпирических данных к простому использованию данных и ожиданию, что паттерны каким-то образом сами в ней проявятся. Эта методология основана на корреляции. Они постоянно повторяют, что корреляция заменила причинность. Но корреляция полностью основана на обнаружении поверхностных паттернов, правильно? Такие вопросы, как «Почему эти паттерны появляются? почему они выглядят так, как они выглядят?» теперь вторичны. Если нечто выглядит, как что-то другое, то оно с определенной вероятностью определяется, как вот это вот «что-то другое», независимо от того, действительно ли это «что-то другое» или нет. Внешнее подобие стало чем-то вроде инструмента идентификации, а ведь именно так и работает расизм. Расизм не пытается узнать о людях ничего, кроме того, как они выглядят. Это поверхностная идентификация, и я действительно удивлена, что никто из-за этого не ставит под сомнение корреляционные модели обнаружения паттернов. IBM-овскую машину Холлерита использовали для облегчения процессов депортации во время Холокоста. Вот почему я всегда очень подозрительно отношусь к любому методу точного определения этнической идентичности.

Кейт Кроуфорд: Именно этим и занимались машины Холлерита по отношению к разным этническим группам.

Хито Штейерль: Если сделать шаг назад, то можно сказать, что нам нужно больше разнообразных выборок, чтобы улучшить результаты или обеспечить больше разнообразия в распознавании лиц, машинном обучении, анализе данных и так далее. Но если честно, я думаю, все еще страшнее. Я бы предпочла, чтобы за мной не могли следить, тому, чтобы за мной следили с повышенной точностью. Если требовать более точного распознавания или более реалистичных выборок, то появляется опасность, что способность машин к идентификации увеличится, и мне не кажется, что это хорошая идея.

Хочу рассказать тебе смешную историю, о которой я в последнее время много думаю. На мою электронную почту обрушивается гора спама от Республиканской партии США. Мне каждый день, даже каждый час, приходят письма от Дональда Трампа, от Эрика Трампа, от Майка Пенса, от Ньюта Гингрича — вообще ото всех, они все у меня в почте. И я думала, почему они нацелились на меня? В этом же нет никакого смысла. Я даже не имею права голосовать, но недавно я ездила во Флориду, и я думаю, мое присутствие там было как-то зарегистрировано, система связала этот факт с моим именем и пришла к выводу, что я испаноязычный мужчина-избиратель из Флориды. Так что теперь мне приходят все эти письма, и я совершенно ошеломлена. Но по мне, лучше, чтобы меня таким вот способом неправильно идентифицировали, чем если бы мои характеристики точно определили и использовали для рекламы или для того, чтобы за что-то арестовать.

Кейт Кроуфорд: В этих ошибках есть что-то завораживающее, в том, что они до сих пор появляются. Системы, о которых мы говорим, несовершенны, и не только на уровне своих предположений о том, как работают люди и как функционирует общество, но и касательно нас самих как личностей. Мне нравится, когда мне показывают рекламу, совершенно не соответствующую интересам демографической группы, к которой я принадлежу. Теперь Google рассылает тем, кого он посчитал американцами, напоминания пойти и проголосовать завтра на выборах. Я их получаю каждый раз, когда проверяю свою почту. Конечно, я не американка, я австралийка, у меня нет права голосовать на выборах в США, но мне постоянно напоминают о том, чтобы я сделала это. У Google так много информации обо мне — нет сомнений, что он знает, что я австралийка — но связь между огромным морем данных и применением этого знания до сих пор очень слаба.

Ты отметила фундаментальный парадокс современности: если система неправильно тебя идентифицирует, ты не можешь получить доступ к недвижимости, к возможностям кредитования, тебя не выпустят из тюрьмы. В конечном итоге, ты хочешь этой идентификации, но в то же время, чем более точные данные есть у систем и чем больше у них исторического знания о тебе, тем глубже ты погружаешься в эти системы. Парадокс одновременного желания, чтобы тебя лучше узнавали, и нежелания, чтобы тебя узнавали вообще, сейчас широко обсуждается. Каково политическое решение этого парадокса? Я не думаю, что оно простое. К сожалению, мне кажется, что машина коммерции везет нас в сторону «тотального знания», что означает, что хотя мы и замечаем глитчи в работе системы, очень скоро она научится лучше распознавать.

искусственный интеллект окружает нас. люди не представляют, как часто они соприкасаются с ним в своей жизни. они думают, что это система из будущего, которой пока просто нет, но это часть нашей повседневности. нас наблюдают во все большем разрешении, пока системы вокруг нас все больше сливаются с действительностью.

Мы можем быть узнанными многими способами. Они несовершенны и изобилуют неверными смыслами и ассоциациями, тем не менее, веревка затягивается вокруг нас, в то время как сети капитала все лучше заметают свои следы. Я знаю, что ты также размышляешь о криптовалютах, о том, что в них остается скрытым, а что оказывается видимым. Или возьмем, к примеру, искусственный интеллект. Искусственный интеллект окружает нас. Люди не представляют, как часто они соприкасаются с ним в своей жизни. Они думают, что это система из будущего, которой пока просто нет, но это часть нашей повседневности. Нас наблюдают во все большем разрешении, пока системы вокруг нас все больше сливаются с действительностью.

Хито Штейерль: Мне очень нравится начало твоего текста, который я как раз читала, когда ты позвонила: «Искусственный интеллект трудно увидеть». В нем ты пишешь, что самые серьезные социальные конфликты сейчас вызываются «системами слабого искусственного интеллекта». Я с этим совершенно согласна. Я называю эти системы «искусственной глупостью», и я думаю, что они сильно влияют на нашу жизнь. Главным из нежелательных последствий, конечно, будет автоматизация. Автоматизация уже становится причиной неравенства и социальной фрагментации — речь о нативистских, полуфашистских и даже фашистских движениях. Чем «умнее» становятся программы, тем сильнее будет фрагментироваться и поляризоваться общество. Думаю, что многие из тех политических проблем, которые мы сегодня наблюдаем, вызваны искусственной глупостью.

Кейт Кроуфорд: Это интересно. В своей работе я размышляю о появлении искусственного интеллекта как сверххищника. Согласно нарративу, который производит Кремниевая долина, самая главная угроза со стороны искусственного интеллекта — это создание суперинтеллекта, который подчинит себе человечество. В реальности же единственные люди, которые могли бы понять, что это уже происходит, и есть теперешние сверххищники. Если ты богатый белый мужчина, который управляет крупной технологической компанией или компанией венчурного капитала в Кремниевой долине, сингулярность может звучать для тебя очень угрожающе. Но для всех эти угрозы уже стали реальностью. Мы уже живем в мире с системами, которые подчиняют население в наиболее грубых формах.

В США произойдет полная автоматизация автомобильных грузоперевозок. Сейчас автомобильные грузовые компании — одни из главных работодателей в стране, так что мы наблюдаем уничтожение важного сегмента рынка труда. Но если вы замените дальнобойщиков на грузовики-автопилоты, то вам все равно понадобится кто-то, кто будет охранят грузы. Это значит, что некоторых в этой отрасли продолжат брать на работу, но, видимо, уже как охранников. Категории работников меняются, и людей накрепко сцепят с автономными машинами. В случае работника с высокой квалификацией это будет означать разработку новых систем искусственного интеллекта, но для остальных людей это будет просто предоставление мускульной силы. На спешном пути к автоматизации нам нужно быть внимательными к изменениям в том, как мы понимаем человеческий труд.

Хито Штейерль: В то время как людей заменяют системы, одной из немногих человеческих работ остается охрана. Я недавно была в супермаркете в Голландии, и там буквально не осталось ни одного кассира, только охранник. Всех женщин-кассиров (а это была в основном женская работа) теперь заменили одним охранником. Это было невероятно.

Кейт Кроуфорд: В долгосрочной перспективе развития человеческого труда последним пережитком останется работа охранника. Он последним покинет здание.

Хито Штейерль: Что-то вроде армии мелкого пошиба.

Кейт Кроуфорд: Это напоминает мне шутку, которую ты рассказала, когда мы когда-то давно говорили о сингулярности. Я рассказывала о своей теории сверххищника, и ты сказала: «Знаешь, люди думают, что сверхинтеллект – это дело будущего, но он уже здесь. Он называется «неолиберализм».

Хито Штейерль: Но ведь так и есть, разве нет?

Кейт Кроуфорд: Обожаю эту шутку. Это моя любимая шутка от Хито.

Пока я утром перечитывала твою работу, я вспомнила, что ты писала об идее товарища, и я размышляла о ценности товарищества. Что значит быть товарищами в мире машинного видения и автономных агентов? Может ли такое понятие существовать в этих пространствах? Где это товарищество найти?

Хито Штейерль: Предпосылка товарищества не рассматривается в развитии этих систем. Сегодня я читала очень интересную научную статью о компьютерной симуляции общественных процессов. В ней рассказывалось, как был разработан агент, который был похож на человека в том смысле, что он был нерациональным, то есть у него были эмоции и так далее, но каждый раз, когда ему позволяли выходить из-под контроля, он начинал убивать. Они убивали друг друга очень быстро. Они не могли выжить. Чистый геноцид. Я не знаю, какая у этого причина, но я предполагаю, что одной из причин было то, что они не смогли формализовать эмпатию и чувство солидарности. Возможно, они использовали формулу гомофилии или предпочтений на основе сходства. Но гомофилия — это не солидарность, и мне действительно интересно, как бы выглядели такие системы, если бы в них внедрили что-то подобное. Вероятно, они бы выглядели совсем по-иному, но мы не знаем. А пока этого внедрения не произошло, такие симуляции представляют нам как научное воспроизведение человеческого поведения.

Кейт Кроуфорд: Я часто думаю о концепте солидарности в мире, где технологии накладываются на повседневные действия и пытаются индивидуализировать и гипермонетизировать не только личностей, но и любые виды взаимодействия. Каждый свайп, любые введенные данные, категоризируют и отслеживают. Идеал солидарности различного кажется таким сильным потому, что кажется недостижимым. Может, в этом и есть его сила: кажется, будто он находится за пределами моделей сбора данных и социального моделирования.

Хито Штейерль: Ты можешь привести пример искусственного интеллекта, который бы был сосредоточен на эмпатии и солидарности? Есть ли где-то в этих системах место идее товарищества?

Кейт Кроуфорд: Я вернусь в самое начало. Я вернусь к Тьюрингу и даже к одной из первых систем, подвергнутых тесту Тьюринга, Элизе. Элиза — это простейшая из систем. Ее никак нельзя назвать настоящим искусственным интеллектом, и она даже не приспосабливается к разговору, но в ней есть такая простая функция, как «слушать», которая повторяет твои фразы, но в виде вопросов. На людей это воздействует невероятно. Некоторым казалось, что этого будет достаточно, чтобы заменить психотерапевта. Но у Элизы были жесткие ограничения, потому что она на самом деле не могла проявлять эмпатию, не могла понимать, но я не думаю, что мы с тех пор далеко продвинулись. Элиза — это машина по производству эмпатии, потому что она была просто слушателем. Она не пыталась быть умнее своих собеседников, она просто пыталась слушать, и это было очень мощно.

Перевод Сергея Бабкина

Оригинал статьи